MaxCompute湖仓一体近实时增量处理技术架构揭秘

随着大数据和云计算技术的快速发展,企业数据处理需求日益复杂,对数据处理的时效性、灵活性和成本效益提出了更高要求。阿里云MaxCompute作为领先的数据处理平台,结合湖仓一体(Lakehouse)架构,推出了近实时增量处理技术,为企业数据处理服务带来了革命性的提升。本文将从技术架构、核心组件与数据处理流程三个方面,深入揭秘MaxCompute湖仓一体的近实时增量处理技术。

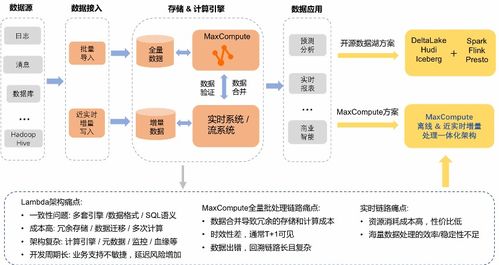

一、技术架构概述

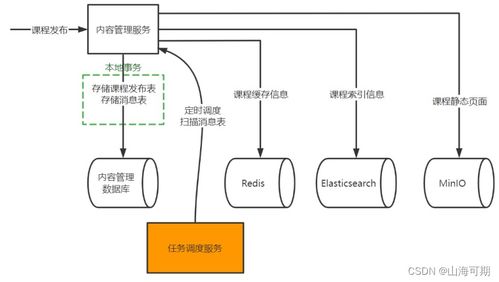

MaxCompute湖仓一体架构融合了数据湖的灵活性和数据仓库的高性能,支持结构化、半结构化和非结构化数据的统一存储与处理。近实时增量处理技术是该架构的核心之一,它通过流批一体、增量更新和事务一致性机制,实现了数据从产生到分析的低延迟处理。架构主要包括数据源层、接入层、存储层、计算层和服务层:

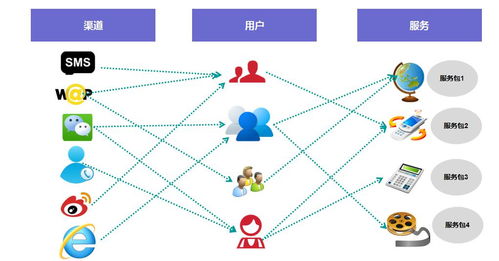

- 数据源层:支持多种数据源,如数据库日志、IoT设备、应用程序事件等,通过CDC(Change Data Capture)或消息队列(如Kafka)实时捕获增量数据。

- 接入层:采用MaxCompute Tunnel或DataHub服务,实现数据的快速接入和缓冲,确保数据高效流入存储层。

- 存储层:基于对象存储(如OSS)构建统一数据湖,同时利用MaxCompute的表存储格式(如ORC、Parquet)优化数据组织,支持ACID事务和增量快照。

- 计算层:通过MaxCompute SQL、Spark或Flink引擎,实现流批混合计算,自动处理增量数据,并提供近实时查询能力。

- 服务层:为上层应用提供数据API、数据服务和可视化工具,支持实时报表、机器学习和业务分析。

二、核心组件与技术特点

MaxCompute近实时增量处理技术的成功依赖于多个核心组件:

- 增量数据捕获:使用Debezium或自定义CDC工具,从源系统捕获数据变更事件,确保数据完整性和低延迟。

- 流式处理引擎:集成Flink或Spark Streaming,处理实时数据流,支持窗口计算、状态管理和容错机制。

- 统一元数据管理:通过Hive Metastore或MaxCompute内置元数据服务,实现数据湖和仓库的元数据一致性,简化数据发现和治理。

- 增量合并与优化:采用Delta Lake或Iceberg等开源表格式,支持增量数据的合并、压缩和版本控制,减少存储冗余并提升查询性能。

- 事务保障:基于多版本并发控制(MVCC)和快照隔离,确保在并发场景下数据的一致性和可靠性。

技术特点包括:

- 近实时处理:数据从产生到可查询的延迟可控制在分钟级,满足业务对时效性的需求。

- 成本效益:通过增量处理减少全量计算,降低资源消耗和成本。

- 灵活性:支持多种数据格式和计算引擎,便于企业根据场景选择最佳方案。

- 易用性:提供SQL接口和可视化工具,降低开发门槛,提升数据处理效率。

三、数据处理流程与实战应用

在实际应用中,MaxCompute湖仓一体的近实时增量处理技术广泛应用于电商、金融、物联网等领域。典型数据处理流程如下:

- 数据采集:从业务数据库(如MySQL)通过CDC工具捕获增量数据,并发送到消息队列。

- 数据接入:使用DataHub或Tunnel服务将数据接入MaxCompute存储层,存储在数据湖中。

- 增量计算:通过Flink作业处理实时数据流,进行数据清洗、转换和聚合,结果写入增量表。

- 数据服务:利用MaxCompute的查询引擎,提供近实时数据分析,并通过DataWorks或Quick BI等服务输出结果。

例如,在电商场景中,该技术可用于实时更新用户行为数据,支持个性化推荐和库存监控。通过增量处理,企业能够快速响应市场变化,提升业务敏捷性。

MaxCompute湖仓一体的近实时增量处理技术通过创新的架构设计和核心组件,实现了数据处理的高效、实时和统一。它不仅降低了数据管理的复杂性,还为企业提供了强大的数据处理服务,助力数字化转型。随着AI和边缘计算的融合,这一技术将进一步演进,满足更广泛的数据处理需求。

如若转载,请注明出处:http://www.baolaiyaotong.com/product/20.html

更新时间:2026-01-13 05:32:50